watermark papers

[TOC]

CD-UAP: Class Discriminative Universal Adversarial Perturbation(AAAI,2020)

Consequently, it can be of practical relevance for an attacker to have control over the classes to attack. A natural question arises whether it is possible to craft a universal perturbation that fools the network only for certain classes while having minimal inflfluence on other classes

没怎么看懂

攻击方的角度控制分类/分割网络的分类结果。要求控制具有灵活性,能够控制特定的类别,而不影响其他类别

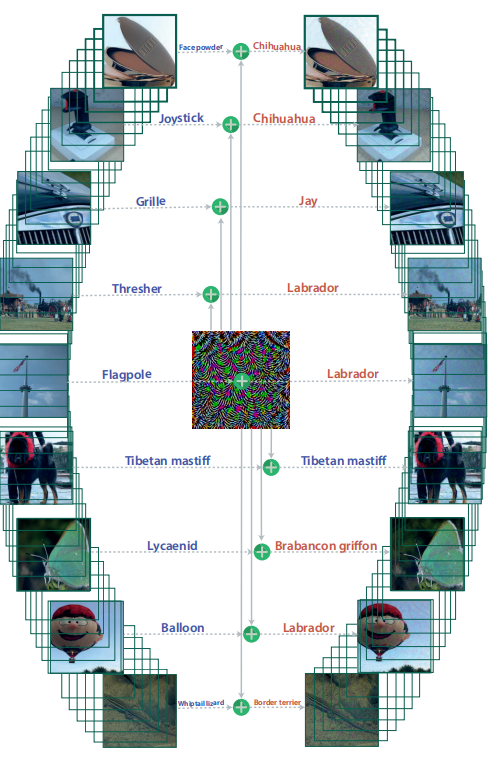

UAP:A single universal adversarial perturbation (UAP)

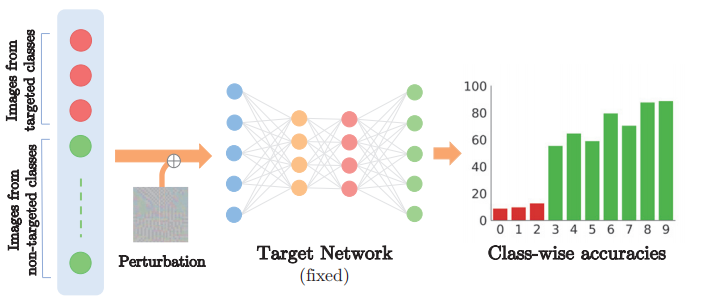

CD-UAP:class discriminative universal adversarial perturbation(CD-UAP)

THE Target of CD-UAP: maximizing the attack success rate og the targted classes ,while minimizing the influence of perturbation on non-targeted classes.

Attack categorize: targeted and non-targeted ,white box an black box ,image dependent and image agnostic attack.

图像相关攻击-图像无关攻击

提前计算是什么意思?

图像相关攻击:针对某个特定图像的攻击。不能提前计算?,可以自由选择类别

图像无关攻击:又被称为UAP,对所有的图像进行攻击。可以提前计算?,但是不呢自由选择类别

CD-UAP

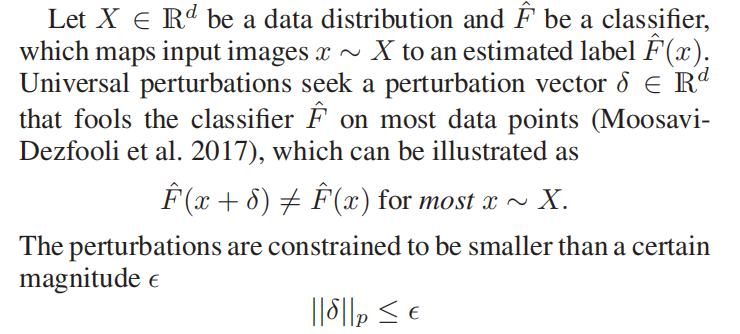

- AC-UAP通用公式

对于多数图片,加入一个小的扰动之后,分类结果会改变,这是网络的一个有趣的特点。扰动小于某个阈值,是为了人眼的不可视。

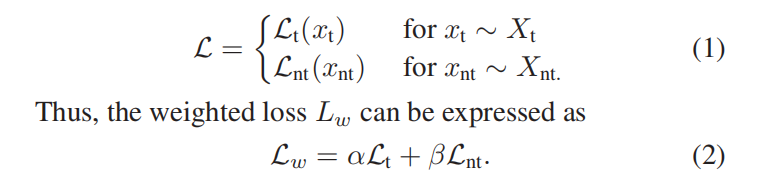

CD-UAP通用公式:

t表示选中的类别,nt表示没有选中的类别

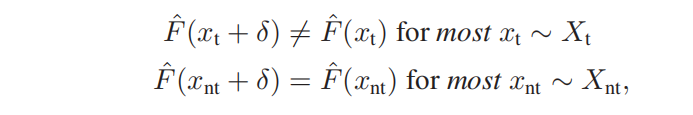

- 算法伪代码

主要对目标类别和非目标类别采用两种loss约束。而不是仅在目标类别加入扰动,这东西挺复杂的,但是即使是仅在目标类别加入扰动也会导致非目标类别的变化

有两个目标:targeted 图像应当引导loss欺骗网络,而non targeted图像应当引导loss,使得扰动对于non targeted 的图像的干扰不影响预测。使用target类和非target类的两个loss约束,非target类loss的权重越大,要求攻击越隐蔽;target类loss权重越大,攻击越大。

A Survey on Deep Convolutional Neural Networks for Image Steganography and Steganalysis

挺复杂的综述

Attention Based Data Hiding with Generative Adversarial Networks

期刊:AAAI 2020

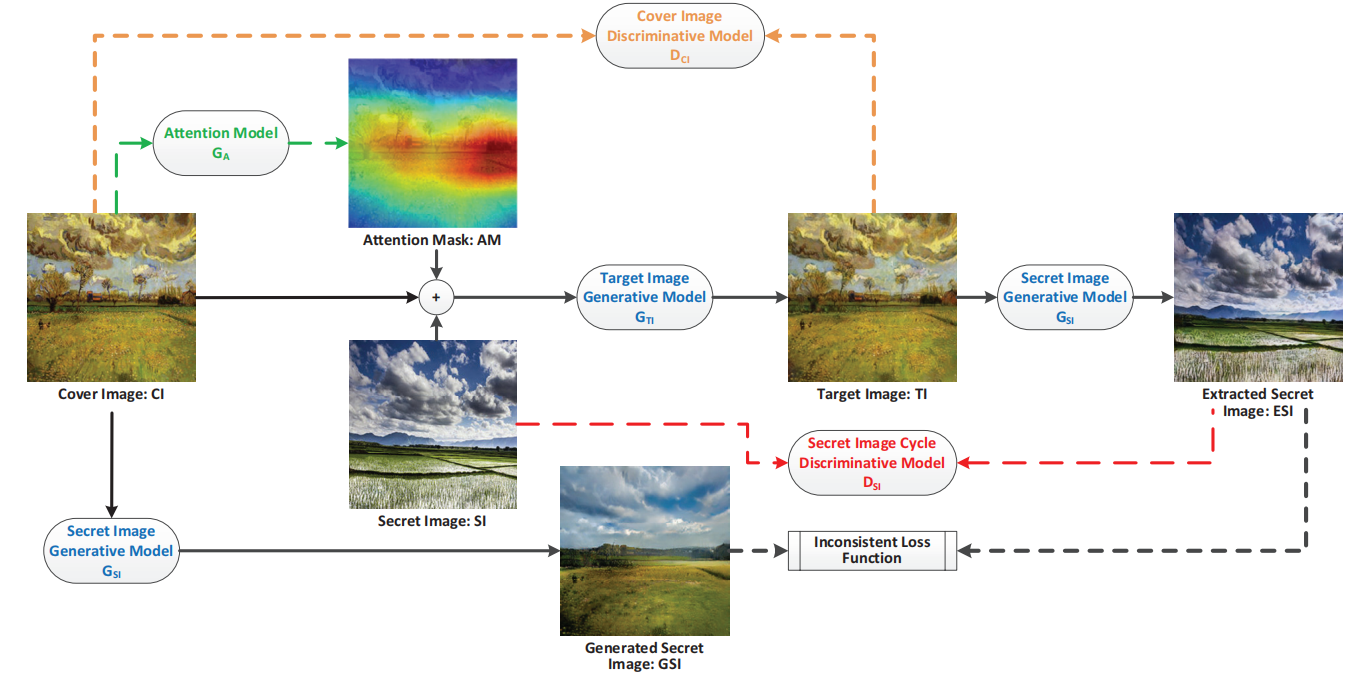

简述:应用注意力机制,使用GAN生成隐写图像

作者:Chong Yu

机构:NVIDIA Corporation

注意力机制生成隐写图像

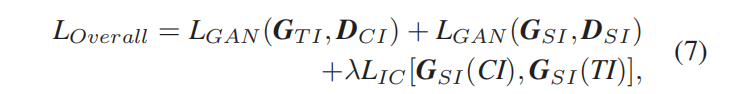

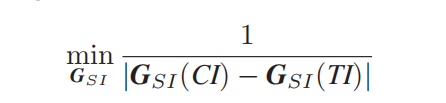

Lic要求cover的提取和target(container)的提取相差很大,min(1/x),要求分母越大 越好。很有道理,这可能对鲁棒性有帮助。

Lgan就是正常的GAN loss的判别器,要求达到纳什均衡,博弈无法判别真假生成图像的真假。

Universal adversarial perturbations

期刊:cvpr 2017

简述:一种通用扰动方法UAP,对所有图像进行扰动,无法进行特定类的干扰。对普遍网络可行

作者:Seyed-Mohsen Moosavi-Dezfooli

机构:瑞士洛桑理工学院

代码:The code is available for download on https://github.com/LTS4/universal. A demo can be found on https://youtu.be/jhOu5yhe0rc.

感觉没什么用,至少对watermark是没什么用处的,虽然和noise layer设计有一点关系,和noise layer的主要区别在于noise layer 没有最小扰动的约束,可以随意加入攻击。

fool the State Of Art deep neural network

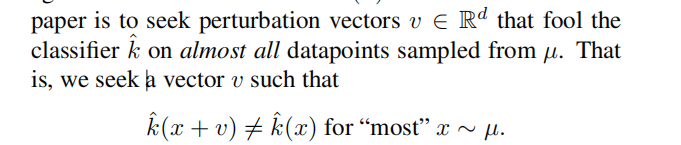

目的是寻找一个向量v,使得这个向量能够扰动全部的图像。并要求最小化v

算法很简单,就是递增v,直到到达网络错误率和v最小化的要求

Understanding Adversarial Examples from the Mutual Inflfluence of Images and Perturbations

期刊:cvpr 2020

简述:第一个没有使用原始图像数据集对图像进行通用攻击

作者:Chaoning Zhang

机构:Robotics and Computer Vision (RCV) Laboratory 韩国科学技术高级研究所(KAIST)

感觉这个机构挺厉害的。

- 使用代理数据集Proxy dataset(不懂)获取随机源的图像,使不知晓源数据集的信息。

- 提出:UAP(Universal adversarial perturbations)是特征,而不是噪声。在图像中的表现形式是噪声。通用攻击扰动需要在不知晓数据集的情况下进行,原因在于攻击者确实在多数情况下无法获取训练数据集。

- 以往方法:UAP 是一种图像噪声。

普遍对抗扰动表现得像主要特征,而图像本身表现为噪声。

AE(Adversarial Examples)中攻击的实际效果是一种主导的特征,在图像中的表现为噪声。

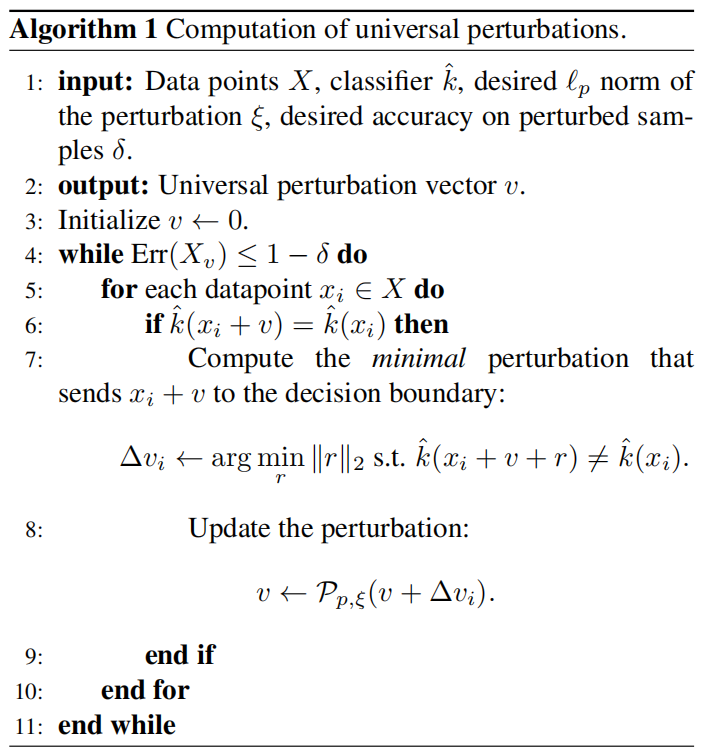

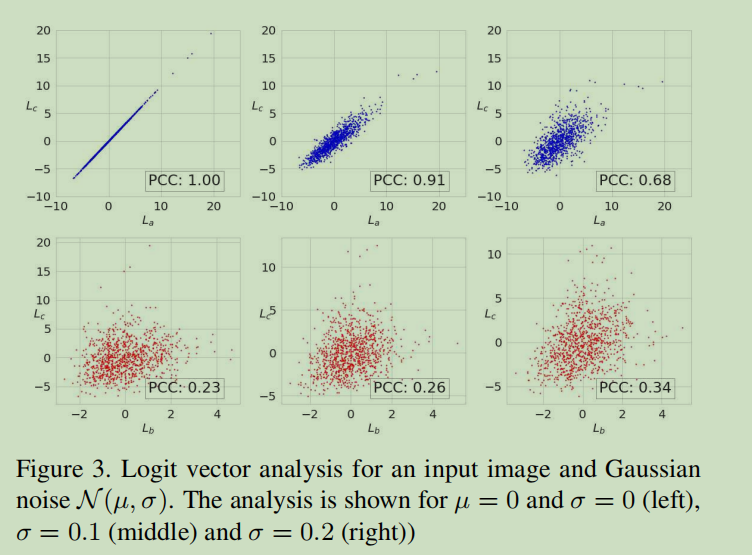

依据相关系数进行实验,协方差/两个标准差的积

加入不同噪声造成的相关性PCC。接近直线表示相关性越高。

没看懂。

Adversarial Examples are not Bugs, they are Features

期刊:NIPS 2019

简述:

作者:Andrew Ilyas

机构:不明

看不懂,公式很多,没多大用处,讲了一些稀奇古怪的东西。

对抗样本在机器学习中引起了广泛关注,但其存在和普遍存在的原因尚不清楚。对抗性样本可以直接归因于非鲁棒特征的存在:具有高度预测性的特征(来自数据分布中的模式),但很脆弱,(因此)对人类来说是不可理解的。在理论框架内捕获这些特征后,确定它们在标准数据集中广泛存在。提出了一个简单的设置,可以严格地将在实践中观察到的现象与(人为指定的)鲁棒性概念和数据固有几何之间的不一致联系起来。

With Friends Like These, Who Needs Adversaries?

对抗样本,这个领域很古怪。感觉没有干什么实事。

期刊:NIPS 2018

简述:

作者:Saumya Jetley∗1 Nicholas A. Lord∗1,2 Philip H.S. Torr1,2

机构:Department of Engineering Science, University of Oxford

code: replicating all experiments is provided at https://github.com/torrvision/whoneedsadversaries

图像空间方向,和攻击的关系。图像空间方向是应用于分类的重点,在沿着同一图像空间方向的改变就成了扰动

通过一组相当直接的实验和解释,我们澄清了对抗性例子代表的是什么,以及现代dcn目前做什么和不做什么。在这样做的过程中,我们将专注于对手本身的工作与其他试图通过这些网络学习到的特征空间的工作结合在一起

通过抑制某些组件达到的分类网络的鲁棒性,会导致分类精度的下降

SteganoGAN: Pushing the Limits of Image Steganography

期刊:arxiv 2019

简述:使用GAN网络进行水印嵌入,其他也没什么

机构:麻省理工学院

作者:Saumya Jetley∗1 Nicholas A. Lord∗1,2 Philip H.S. Torr1,2

代码:https://github.com/DAI-Lab/SteganoGAN

现代隐写方法

- 基于文件类型隐写

- 空域

- 频域

- 深度水印

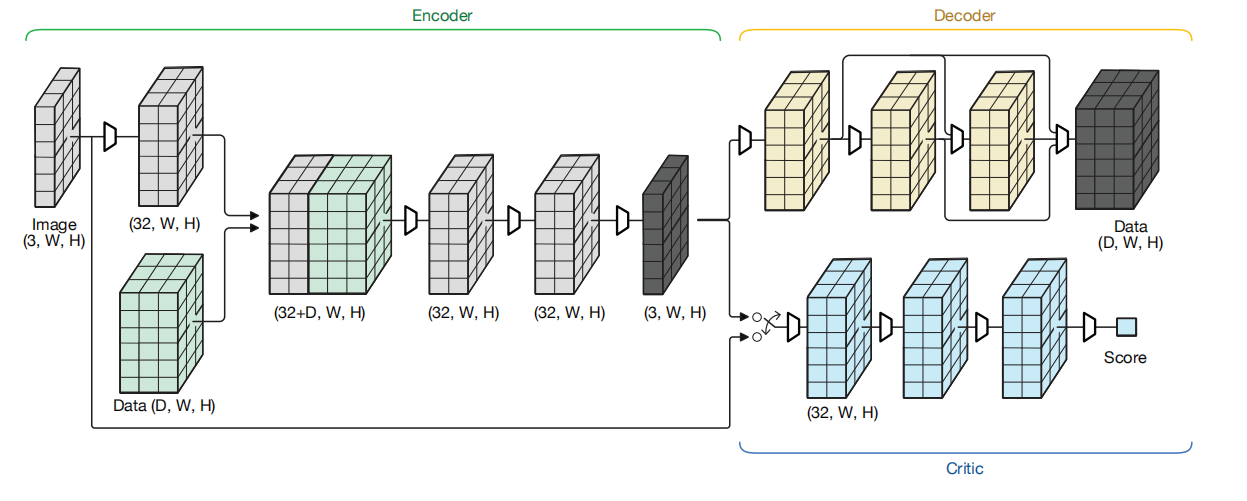

网络结构

是常规的GAN网络

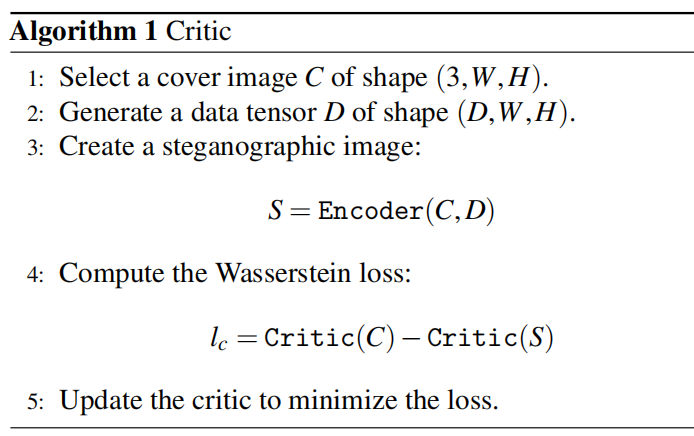

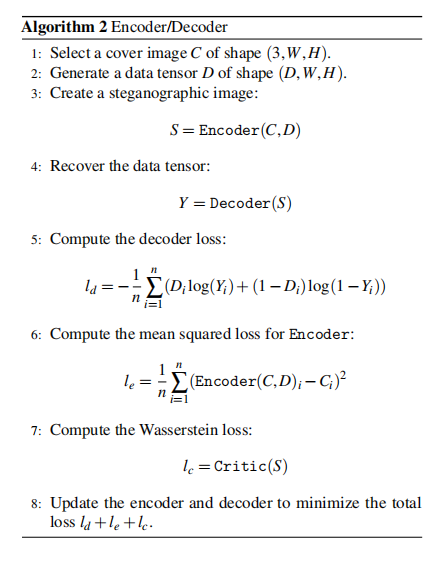

Critic损失,GAN网络的常见损失,就是真-假的概率,这个损失要求判别器中,生成图像逼近真实图像

Generating steganographic images via adversarial training

来源:NIPS 2017

作者:Jamie Hayes

机构:University College London

邮件:j.hayes@cs.ucl.ac.uk

简述:无监督的GAN网络水印模型.哪里来的无监督呀?

watermark任务自带GT的。这个loss函数用的那么大一个监督损失函数。

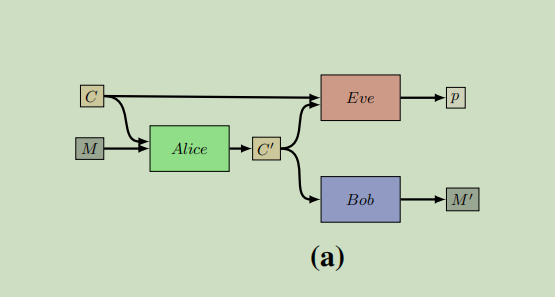

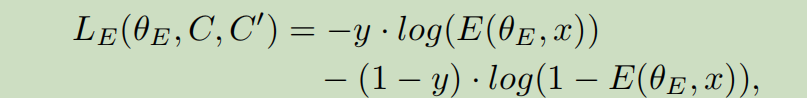

Eve网络loss

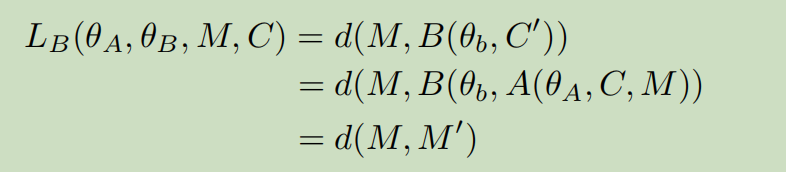

Bob网络loss

两个秘密信息的欧式距离

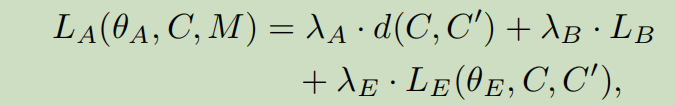

Alice网络loss

两个C的欧式距离

A COVERLOSS IMAGE STEGANOGRAPHY

来源:International Research Journal of Engineering and Technology (IRJET)

作者:S.UMA MAHESWARI

机构:泰米尔纳德邦Panimalar工程学院电子与通信工程学院,印度

简述:没什么用

4页纸的小论文

STN(Spatial Transformers NET)

简述:空间变换网络

作者:Max Jaderberg

单位:Google DeepMind, London, UK

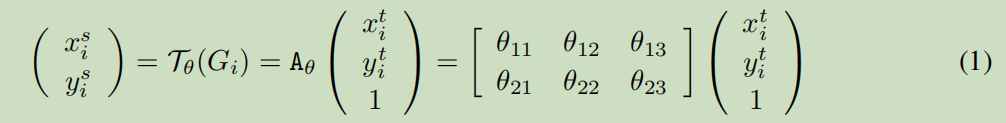

通过卷积和池化和全连接层 生成仿射变换的矩阵。

这个生成仿射矩阵的网络过程可以放在目标网络之前而不需要loss函数约束。